抖音背后的数字巨人 揭秘其服务器规模与海量并发支撑之道

在数字娱乐的浪潮中,抖音以其丝滑的浏览体验和几乎无处不在的内容推送,成为了全球数亿用户日常生活的一部分。当千万级用户同时刷新、上传、互动时,支撑这一切平稳运行的,是一个庞大、复杂且高度智能的技术基础设施体系。人们不禁好奇:抖音的服务器究竟有多大?它又是如何做到同时服务如此海量用户的?

一、 服务器规模:一个分布式的数字帝国

抖音的服务器并非集中在一个“巨型机房”里,而是一个遍布全球的分布式服务器集群网络。其具体规模属于商业核心机密,但我们可以通过公开数据和行业洞察窥见一斑:

- 体量估算:根据其母公司字节跳动的公开资料及行业分析,为支撑抖音(及其国际版TikTok)全球超过10亿的月活跃用户,其服务器总量很可能达到了数百万台的级别。这些服务器分布在全球数十个国家和地区的主要数据中心,如美国、新加坡、爱尔兰、印度等,以实现用户就近访问,降低延迟。

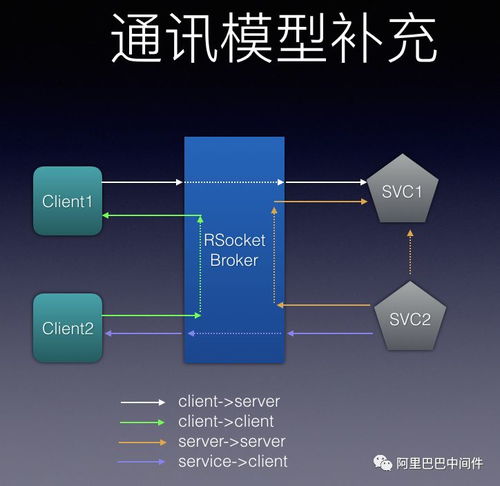

- 架构特点:采用微服务架构和混合云策略。抖音并非完全自建所有数据中心,而是结合了自建IDC(互联网数据中心)与租用大型公有云服务(如AWS、Google Cloud等)的方式,形成混合云。这种架构极具弹性,可以根据流量峰谷(如节假日、大型活动期间)快速伸缩资源,避免资源浪费或服务崩溃。

二、 核心支撑:数据处理与存储的“三板斧”

仅仅有庞大的服务器数量还不够,如何高效地组织、处理和存储天量数据,才是应对高并发的关键。抖音主要依靠以下三大技术支柱:

1. 智能负载均衡与内容分发网络(CDN)

这是应对高并发的第一道防线。

- 负载均衡器:像交通指挥中心,将来自用户的海量请求智能地分发到后端不同的服务器集群,防止单台服务器过载。

- CDN网络:抖音在全球部署了极其庞大的CDN节点。当你刷到一个热门视频时,视频文件很可能就存储在离你物理距离最近的CDN节点上,而非遥远的中心服务器。这实现了毫秒级的视频加载速度,极大地缓解了中心数据中心的压力。

2. 高效的数据处理与流计算

抖音的“推荐算法”闻名于世,其背后是实时数据处理能力的体现。

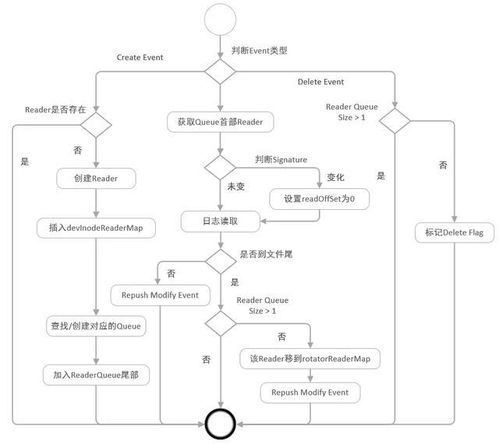

- 流式数据处理平台:用户每一次的点赞、评论、停留时长、转发等行为,都会作为一条数据流实时发送到后端。抖音使用自研的(如火山引擎)或开源的流处理框架(如Apache Flink、Kafka),对这些数据进行实时分析。

- 实时推荐与计算:系统在毫秒到秒级内,根据你的实时行为更新用户画像,并从海量视频库中匹配出你可能感兴趣的下一个视频。这个过程需要惊人的计算能力,依赖于分布式的计算集群。

3. 分层与分片的存储系统

面对每天数以亿计的新增视频和PB级的数据增长,存储系统必须既庞大又敏捷。

- 分层存储:数据根据热度和访问频率被存储在不同介质中。热点视频(刚发布或正流行的)存放在高速SSD存储中,确保瞬间读取;温数据和冷数据(较早的视频)则逐渐迁移到大容量、低成本的机械硬盘或归档存储中,优化成本。

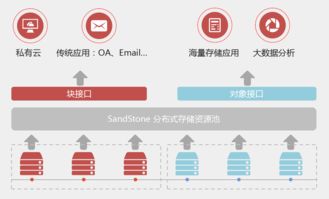

- 分布式数据库与对象存储:

- 用户关系、评论、消息等结构化数据,存储在经过深度优化的分布式数据库(如自研或改进的MySQL集群)中,并通过分库分表技术将数据分散到多台服务器,提升读写性能。

- 视频、图片等非结构化海量文件,则存放在对象存储系统中。这类系统具有近乎无限的扩展能力,是保存抖音核心资产——UGC视频内容的“数字仓库”。

三、 应对峰值:弹性伸缩与混沌工程

抖音的流量并非平稳,晚间高峰、热门话题引爆、明星直播都会带来瞬间流量洪峰。为此,抖音技术团队还运用了更先进的手段:

- 自动化弹性伸缩:基于实时监控,系统可以自动在云平台申请或释放服务器资源,实现“用时扩容,闲时收缩”。

- 全链路压测与混沌工程:他们会模拟“双十一”级别的流量,对生产环境进行全链路压力测试,甚至主动注入故障(如随机关闭某台服务器),以检验系统的冗余性和自愈能力,确保在真实意外发生时服务不中断。

###

因此,抖音服务器的“大”,并不仅仅体现在物理数量上,更体现在其地理分布的广度、架构设计的弹性、软件系统的智能化以及运维体系的先进性上。它是一个将云计算、大数据、人工智能和网络工程技术深度融合的超级工程。正是这个隐藏在“推荐”按钮和滑动屏幕背后的数字巨人,支撑起了我们指尖上流畅而多彩的视听世界。它不断演进,以应对下一个用户量级和更复杂交互形式的挑战。

如若转载,请注明出处:http://www.bswoniu.com/product/62.html

更新时间:2026-03-06 03:26:20